- Ley de Amdahl

-

La Ley de Amdahl, llamada así por el arquitecto de ordenadores Gene Amdahl, se usa para averiguar la mejora máxima de un sistema cuando solo una parte de éste es mejorado.

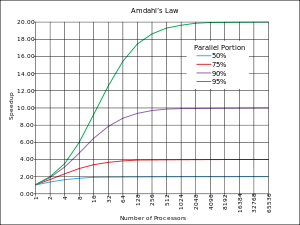

El incremento de velocidad de un programa utilizando múltiples procesadores en computación distribuida está limitada por la fracción secuencial del programa. Por ejemplo, si la porción 0.5 del programa es secuencial, el incremento de velocidad máximo teórico con computación distribuida será de 2 (1/(0.5+(1-0.5)/N)) cuando N sea muy grande.

El incremento de velocidad de un programa utilizando múltiples procesadores en computación distribuida está limitada por la fracción secuencial del programa. Por ejemplo, si la porción 0.5 del programa es secuencial, el incremento de velocidad máximo teórico con computación distribuida será de 2 (1/(0.5+(1-0.5)/N)) cuando N sea muy grande.

Contenido

Introducción

La Ley de Amdahl establece que "la mejora obtenida en el rendimiento de un sistema debido a la alteración de uno de sus componentes está limitada por la fracción de tiempo que se utiliza dicho componente".

La fórmula original de la ley de Amdahl es la siguiente:

donde:

- F = tiempo de ejecución mejorado y

- Fa = tiempo de ejecución antiguo.

Esta fórmula se puede reescribir usando la definición del incremento de la velocidad que viene dado por

, por lo que la fórmula anterior se puede reescribir como:

, por lo que la fórmula anterior se puede reescribir como:

donde:

es la aceleración o ganancia en velocidad conseguida en el sistema completo debido a la mejora de uno de sus subsistemas.

es la aceleración o ganancia en velocidad conseguida en el sistema completo debido a la mejora de uno de sus subsistemas. , es el factor de mejora que se ha introducido en el subsistema mejorado.

, es el factor de mejora que se ha introducido en el subsistema mejorado. , es la fracción de tiempo que el sistema utiliza el subsistema mejorado.

, es la fracción de tiempo que el sistema utiliza el subsistema mejorado.

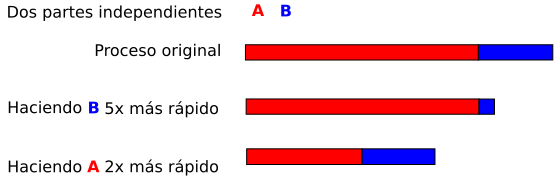

Asumiendo que una tarea tiene dos partes independientes, A y B. B lleva el 25% del tiempo total de computación. Trabajando muy duro, se puede realizar esta parte 5 veces más rápido, sin embargo ésto solo reduce el tiempo de computación un poco. En contraste, una pequeña mejora de la parte A hace que vaya esta el doble de rápido. Esto hace que sea mucho mejor la optimización de la parte A que la parte B aunque se mejore mucho más dicha parte B (5x contra 2x).

Asumiendo que una tarea tiene dos partes independientes, A y B. B lleva el 25% del tiempo total de computación. Trabajando muy duro, se puede realizar esta parte 5 veces más rápido, sin embargo ésto solo reduce el tiempo de computación un poco. En contraste, una pequeña mejora de la parte A hace que vaya esta el doble de rápido. Esto hace que sea mucho mejor la optimización de la parte A que la parte B aunque se mejore mucho más dicha parte B (5x contra 2x).Por ejemplo, si en un programa de ordenador el tiempo de ejecución de un cierto algoritmo supone un 30% del tiempo de ejecución total del programa, y conseguimos hacer que este algoritmos se ejecute en la mitad de tiempo tendremos:

- Am = 2

- Fm = 0.3

-

Es decir, hemos mejorado la velocidad de ejecución del programa en un factor de 1,18. La ley de Amdahl se mide en unidades genéricas, es decir los resultados no son porcentajes, ni unidades de tiempo.

La Ley de Amdahl se puede interpretar de manera más técnica, pero en términos simples, significa que es el algoritmo el que decide la mejora de velocidad, no el número de procesadores. Finalmente se llega a un momento que no se puede paralelizar más el algoritmo.

Referencias

- Gene Amdahl, "Validity of the Single Processor Approach to Achieving Large-Scale Computing Capabilities", AFIPS Conference Proceedings, (30), pp. 483-485, 1967.

Véase también

Enlaces externos

Wikimedia Commons alberga contenido multimedia sobre Ley de Amdahl. Commons

Wikimedia Commons alberga contenido multimedia sobre Ley de Amdahl. Commons- Reevaluating Amdahl's Law

- Reevaluating Amdahl's Law and Gustafson's Law

Categorías:- Arquitectura de computadoras

- Leyes epónimas

- Programación paralela

Wikimedia foundation. 2010.

*

*