- Estimador

-

Estimador

En estadística, un estimador es un estadístico (esto es, una función de la muestra) usado para estimar un parámetro desconocido de la población. Por ejemplo, si se desea conocer el precio medio de un artículo (el parámetro desconocido) se recogerán observaciones del precio de dicho artículo en diversos establecimientos (la muestra) y la media aritmética de las observaciones puede utilizarse como estimador del precio medio.

Para cada parámetro pueden existir varios estimadores diferentes. En general, escogeremos el estimador que posea mejores propiedades que los restantes, como insesgadez, eficiencia, convergencia y robustez (consistencia).

El valor de un estimador proporciona lo que se denomina en estadística una estimación puntual del valor del parámetro en estudio. En general, se suele preferir realizar una estimación mediante un intervalo, esto es, obtener un intervalo [a,b] dentro del cual se espera esté el valor real del parámetro con un cierto nivel de confianza. Utilizar un intervalo resulta más informativo, al proporcionar información sobre el posible error de estimación, asociado con la amplitud de dicho intervalo. El nivel de confianza es la probabilidad de que a priori el verdadero valor del parámetro quede contenido en el intervalo.

En la práctica, en los intervalos suelen indicarse dando el valor del estimador puntual utilizado como centro del intervalo y un valor que debe sumarse y restarse para obtener el límite superior e inferior, por ejemplo:

equivale a

equivale a ![[3,5-2,03\,;\,3,5+2,03]=[1,47\,;\,5,53]](/pictures/eswiki/51/3a27850f0e5e6e074976ff0802e006d1.png)

Contenido

Propiedades de los estimadores

Sesgo

Se denomina sesgo de un estimador a la diferencia entre la esperanza (o valor esperado) del estimador y el verdadero valor del parámetro a estimar. Es deseable que un estimador sea insesgado o centrado, es decir, que su sesgo sea nulo por ser su esperanza igual al parámetro que se desea estimar.

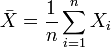

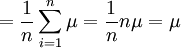

Por ejemplo, si se desea estimar la media de una población, la media aritmética de la muestra es un estimador insesgado de la misma, ya que su esperanza (valor esperado) es igual a la media de la población.

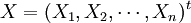

En efecto, si una muestra X=(X1,X2,...,Xn)t procede de una población de media μ, quiere decir que:

E[Xi] = μ para cualquier i=1...n La media aritmética o media muestral,

, con lo que, al aplicar las propiedades de linealidad de la esperanza matemática se tiene que:

, con lo que, al aplicar las propiedades de linealidad de la esperanza matemática se tiene que:![E[\bar X ] = E \left [ \frac {1}{n} \sum_{i=1}^n X_i \right ] =](/pictures/eswiki/100/ddf25562e8565eaa6ed4f5d047f74825.png)

![= \frac {1}{n} E \left [ \sum_{i=1}^n X_i \right ] = \frac {1}{n}\sum_{i=1}^n E \left [ X_i \right ] =](/pictures/eswiki/52/419460eddb49986b791644787502fcfc.png)

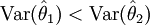

Eficiencia

Diremos que un estimador es más eficiente o más preciso que otro estimador, si la varianza del primero es menor que la del segundo. Por ejemplo, si

y

y  son ambos estimadores de θ y

son ambos estimadores de θ y

,

diremos que

es más eficiente que

es más eficiente que  . Un estimador es más eficiente (más preciso), por tanto, cuanto menor es su varianza.

. Un estimador es más eficiente (más preciso), por tanto, cuanto menor es su varianza.La eficiencia de los estimadores está limitada por las características de la distribución de probabilidad de la muestra de la que proceden. El teorema de Cramér-Rao determina que la varianza de un estimador insesgado

de un parámetro θ es, como mínimo,

de un parámetro θ es, como mínimo,![\mathrm{var} \left(\widehat{\theta}\right)

\geq

\frac{1}

{

\mathrm{E}

\left[

\left[

\frac{\partial}{\partial \theta} \log f(X;\theta)

\right]^2

\right]

}](/pictures/eswiki/97/acc2d5de7ab27f4493fa9477eab6c335.png)

donde f(X;θ) es la función de densidad de probabilidad de la muestra

en función del parámetro θ, (denominada función de verosimilitud). Si un estimador alcanza esta cota mínima, entonces se dice que el estimador es de mínima varianza.

en función del parámetro θ, (denominada función de verosimilitud). Si un estimador alcanza esta cota mínima, entonces se dice que el estimador es de mínima varianza.Consistencia

Si no es posible emplear estimadores de mínima varianza, el requisito mínimo deseable para un estimador es que a medida que el tamaño de la muestra crece, el valor del estimador tienda a ser el valor del parámetro, propiedad que se denomina consistencia. Existen diversas definiciones de consistencia, más o menos restrictivas, pero la más utilizada es la denominada consistencia en media cuadrática que exige que:

-

-

![E[\hat \theta] \to \theta](/pictures/eswiki/51/3b128ab852cf24c5d4684b18bf10363b.png) cuando

cuando

cuando

cuando

-

Robustez

El estimador

será un estimador robusto del parámetro θ si la vulneración de los supuestos de partida en los que se basa la estimación (normalmente, atribuir a la población un determinado tipo de función de distribución que, en realidad, no es la correcta), no altera de manera significativa los resultados que éste proporciona.

será un estimador robusto del parámetro θ si la vulneración de los supuestos de partida en los que se basa la estimación (normalmente, atribuir a la población un determinado tipo de función de distribución que, en realidad, no es la correcta), no altera de manera significativa los resultados que éste proporciona. Portal:Matemática Contenido relacionado con Matemática.

Portal:Matemática Contenido relacionado con Matemática.

Suficiencia

Se dice que un estimador es suficiente cuando resume toda la información relevante contenida en la muestra, de forma que ningún otro estimador pueda proporcionar información adicional sobre el parámetro desconocido de la población.

Invarianza

Se dice que un estimador es invariante cuando el estimador de la función del parámetro coincide con la función del estimador del parámetro,

![\left[ f(\theta) \right]^* = f(\theta^*)](/pictures/eswiki/56/808742d874fcb77ed55063d00c909de2.png) .

.Ejemplo.- Si para estimar la varianza muestral utilizamos la varianza poblacional, entonces para estimar la desviación típica muestral será razonable utilizar la desviación típica poblacional.

Categoría: Inferencia estadística -

Wikimedia foundation. 2010.